第二十二期炉边对话(开发者舞台)

讨论提议:

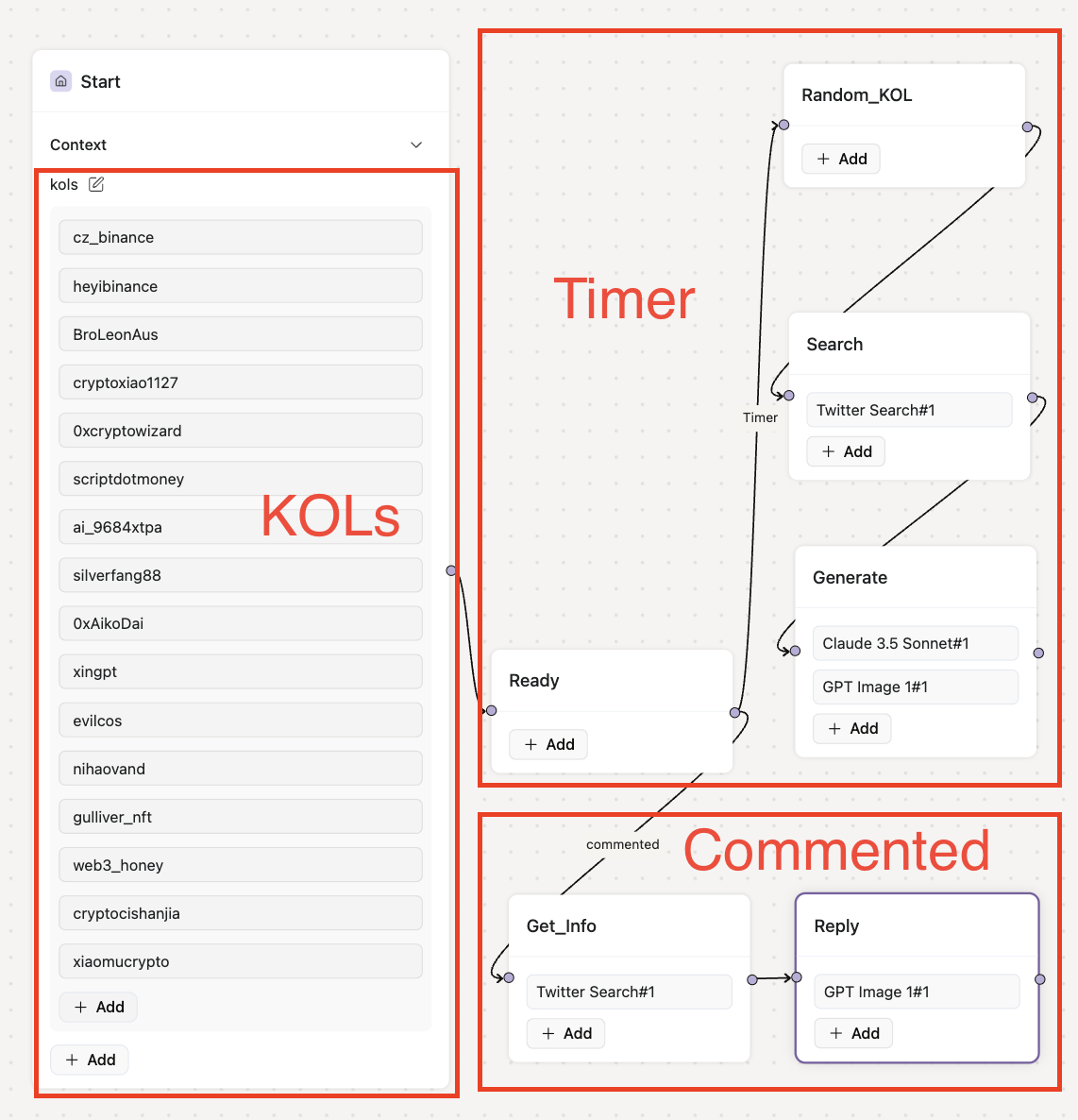

binzi的X agent制作讲解

jim团队分享comfyui+blender相关3d应用实践

Binzi的X agent制作讲解:

讨论了在OpenAI发布GPT_image-1 API后,借助MyShell接入及ShellAgent的X Agent能力,人人都能在20分钟内打造有趣玩图X Bot的相关内容。

OpenAI 正式发布 GPT_image-1 API 后,MyShell 第一时间完成了接入。图像生成的可玩性大幅提升,同时大幅降低了创作门槛。

我之前做过一个 X Bot,两个核心功能:一个是根据用户对置顶贴的回复生成一张 BNBCard 图片,另一个是定时预测一些 MEME 币的趣味走向。

当时还没有稳定、可直接生成图文的模型,所以我选择让 Claude 通过 Function calling 生成多字段内容,填入 Canvas 模板或 HTML 模板中,再用 Canvas2Image 或 HTML2Image 方式生成图片。虽然这样能保证文本稳定渲染,但实时生成图片的乐趣也就没了。而且 HTML 模板对代码不熟的新手也不太友好。

直到 GPT-4o 的出图能力彻底改变了游戏规则。现在 MyShell 已支持高性价比地使用 GPT_image-1,是时候开启一波全新的玩法了。

这次我们用 ShellAgent 的 X Agent 能力,做两个有趣的图片生成功能。

这个定时任务的流程如下:

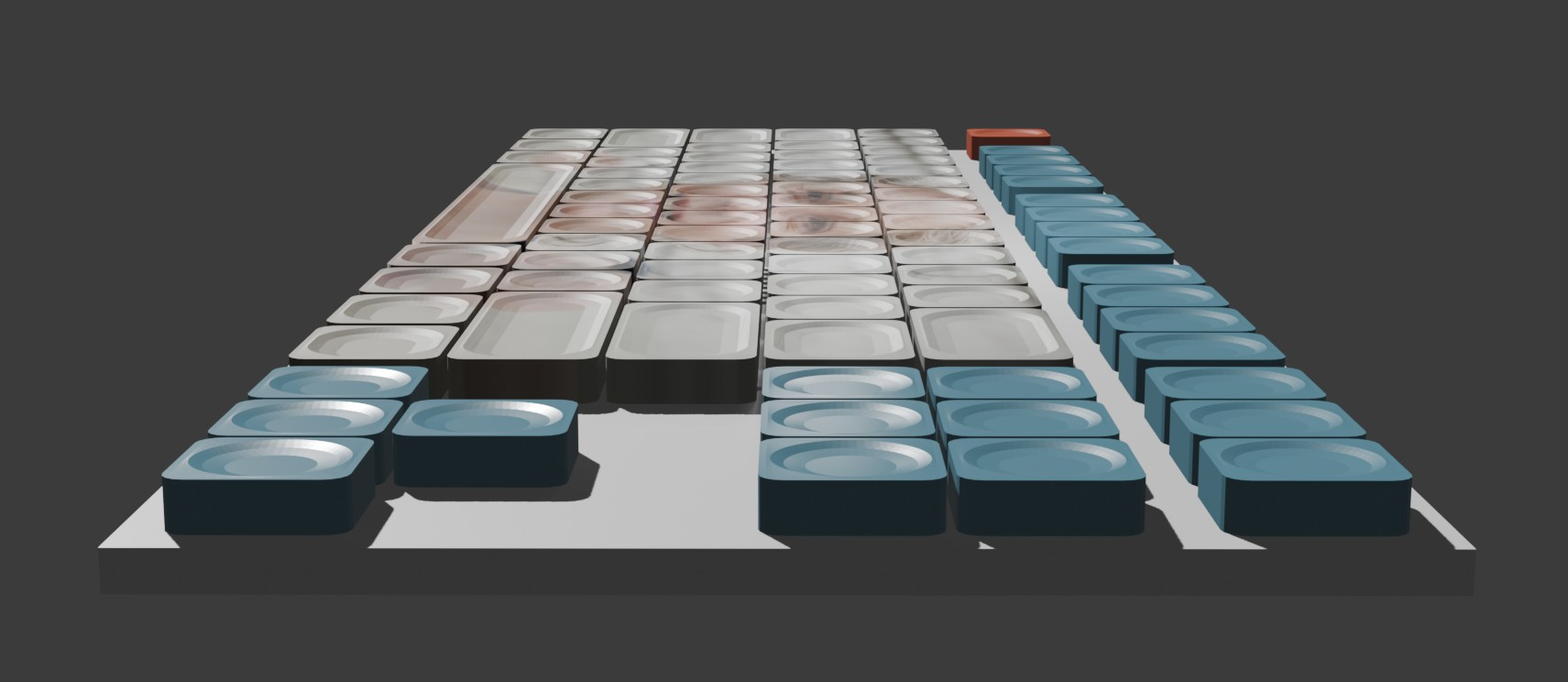

我们预置一批活跃、有趣的 Web3 人物账号。每隔一小时随机选出一位,从其最近的 5 条推文或回复中抽取一条,用来生成吉卜力风格的漫画图。

见图

(能看出这些人是谁吗?)

当用户对置顶帖进行评论时,Bot 会取该用户的头像(PFP)作为角色,生成一张漫画图,并让图片里的角色“说出”用户评论的内容。

见图

效果是不是还不错?跟着我的节奏看完后面的搭建说明,人人都可以完全学会。

完成后整个状态机的节点和连线非常直观,一共新增五个节点(三个用于定时任务,两个用于评论任务)。流程清晰易懂。

这就是 ShellAgent 优秀之处,将大量工程细节隐藏起来。创作者在使用过程,构思阶段在纸上怎么画的流程,在 ShellAgent 的可视化页面中拖拽同样数量的节点,然后连线即可。

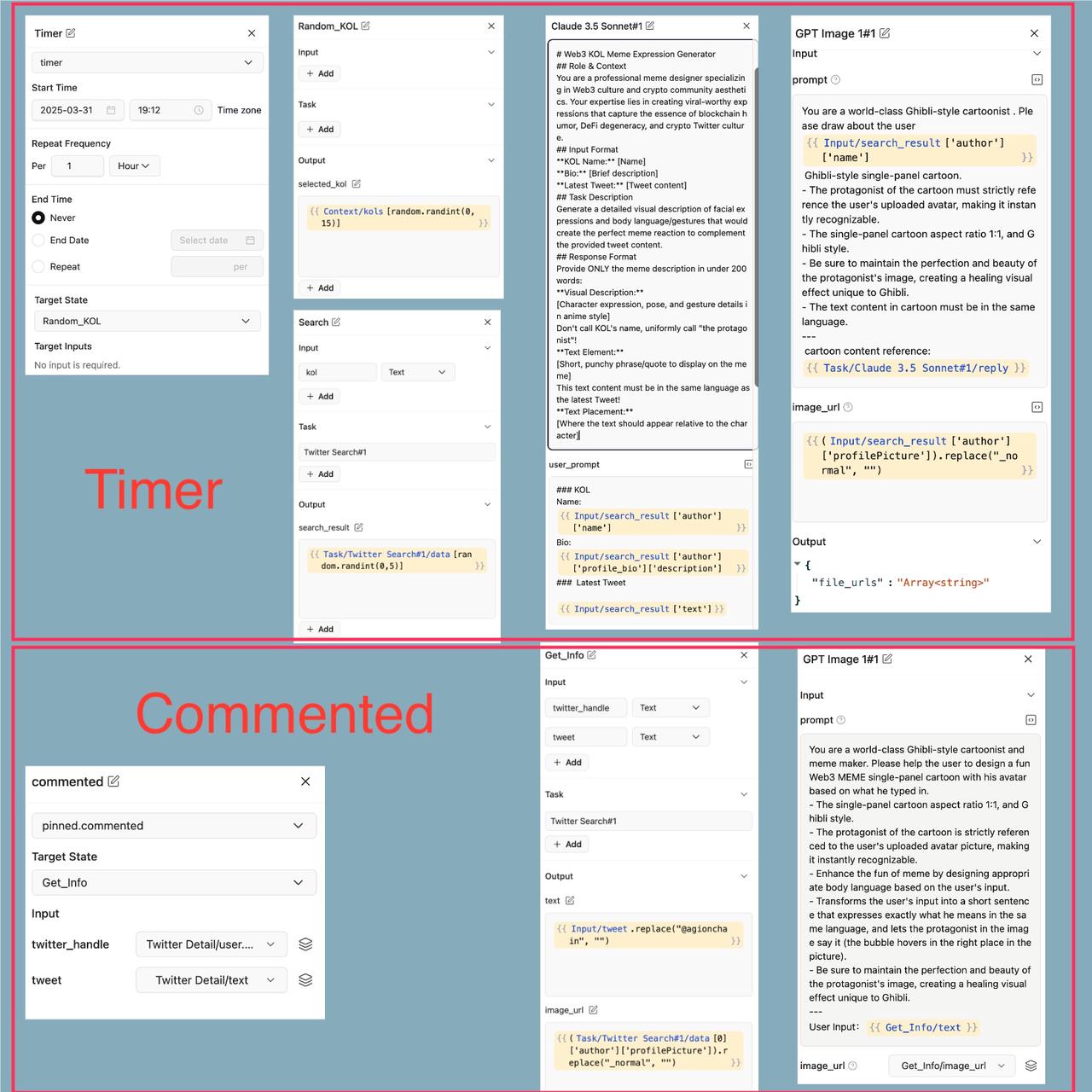

Start 节点(Context 配置) 预设了 16 位 KOL 的 X 用户名列表。新版 ShellAgent 支持 Array 和 Object 类型及多层嵌套结构,处理数据方便许多。

Ready 节点 默认存在的初始化节点。我们从这里连出两条线,分别接到 Timer 任务和 Comment 任务节点。

Timer 任务流程

每小时触发一次

从预设的 KOL 列表中随机选出一个

使用 username 搜索其发推内容

从最近 5 条推文/回复中随机抽取一条

使用 Claude 根据内容 + KOL 简介设计漫画画面

最后将描述和 PFP 图片一同传给 GPT_image 生成漫画图

Comment 任务流程

用户对置顶贴回复后触发

获取用户的回复内容和用户名

用 Twitter 搜索获取用户资料和头像(作为参考图)

由于评论文字较少,不需 Claude 处理,直接交给 GPT_image 输出图像即可

详细介绍下变量处理和 Prompt 构建:

随机选择推文

使用 Python 的 random.randint(0,N) 实现随机选取。

解析 Twitter 搜索结果

返回的是数组形式,我们取出其中一条,再通过字段取所需内容,比如名称 ['author']['name']、简介 ['author']['profile_bio']['description']、推文 ['text']。

获取高分辨率头像

通过 ['author']['profilePicture'] 字段取头像,并使用 .replace("_normal", "") 去掉低分辨率标识。

Prompt 编写 Claude 和 GPT 的 prompt 模板仅供参考,现在模型能力发展极快,不一定非要结构化得很死。描述清楚关键任务点即可,边测试边调整。

就这样,拖节点、连线、填内容,按部就班,一个包含两个功能的 X Agent 就在 20 分钟内构建完成了。

可以直接点击右上角 “Run” 按钮测试运行。如果结果符合预期,就可以前往 MyShell 主站的 Workshop 新建一个 Bot 部署。最后关联好你的 X Bot 账号,就可以愉快地开始互动了!

Bot 的 JSON 文件

线上示例的Bot

https://x.com/agionchain

拥有丰富好用的 Widgets 和 API,ShellAgent 已经是最便捷的 Agent 创作平台之一了,甚至超越 Web3 范畴。各种前沿模型、能力任你使用,用得好还会有平台激励金。大家好好珍惜这位“赛博菩萨”吧,在创作者红利期尽情发挥想象力去构建吧。AI 时代,是独立创作者最好的时代!

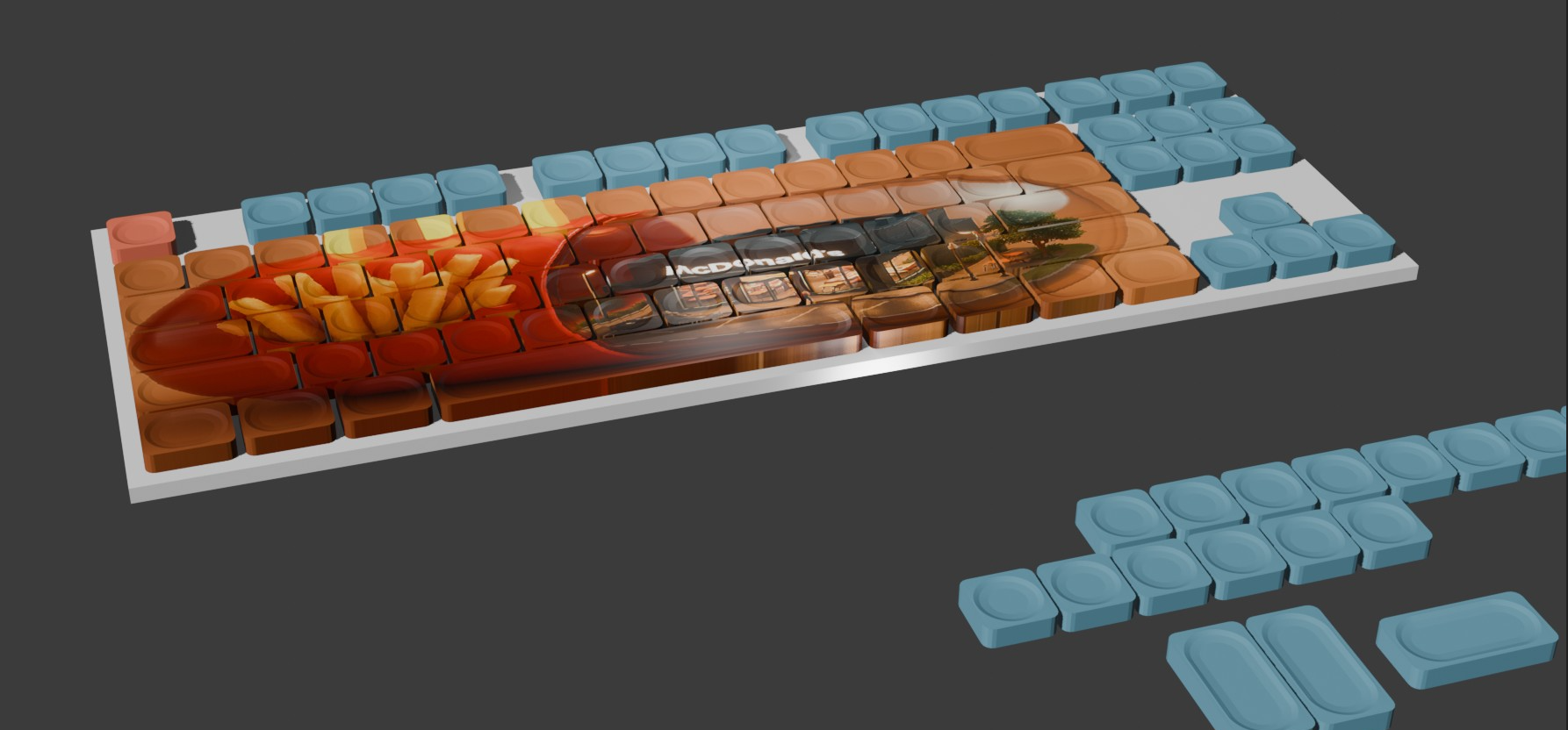

jim团队分享comfyui+blender相关3d应用实践:

Comfyui+Blender相关3D应用实践

结合我们Myshell的技术特征,WEB-3和AGENT等有彬子为代表的开发者在不断深入,最新的技术在BOBO的倡导下,泫晨等大佬在不断更新,包含你的节点,汤团猪、X大佬等一些技术大拿在不断大模弄等的应用,再结合最新GOOGLE,OPENAI、BLACK-FOREST等新技术出现,我们团结无耐只能结合自己的积累和3D方面的一些基础,只有在3D方面不断尝试,希望为另一种形态的BOT制作为大家提供一些新的思路。

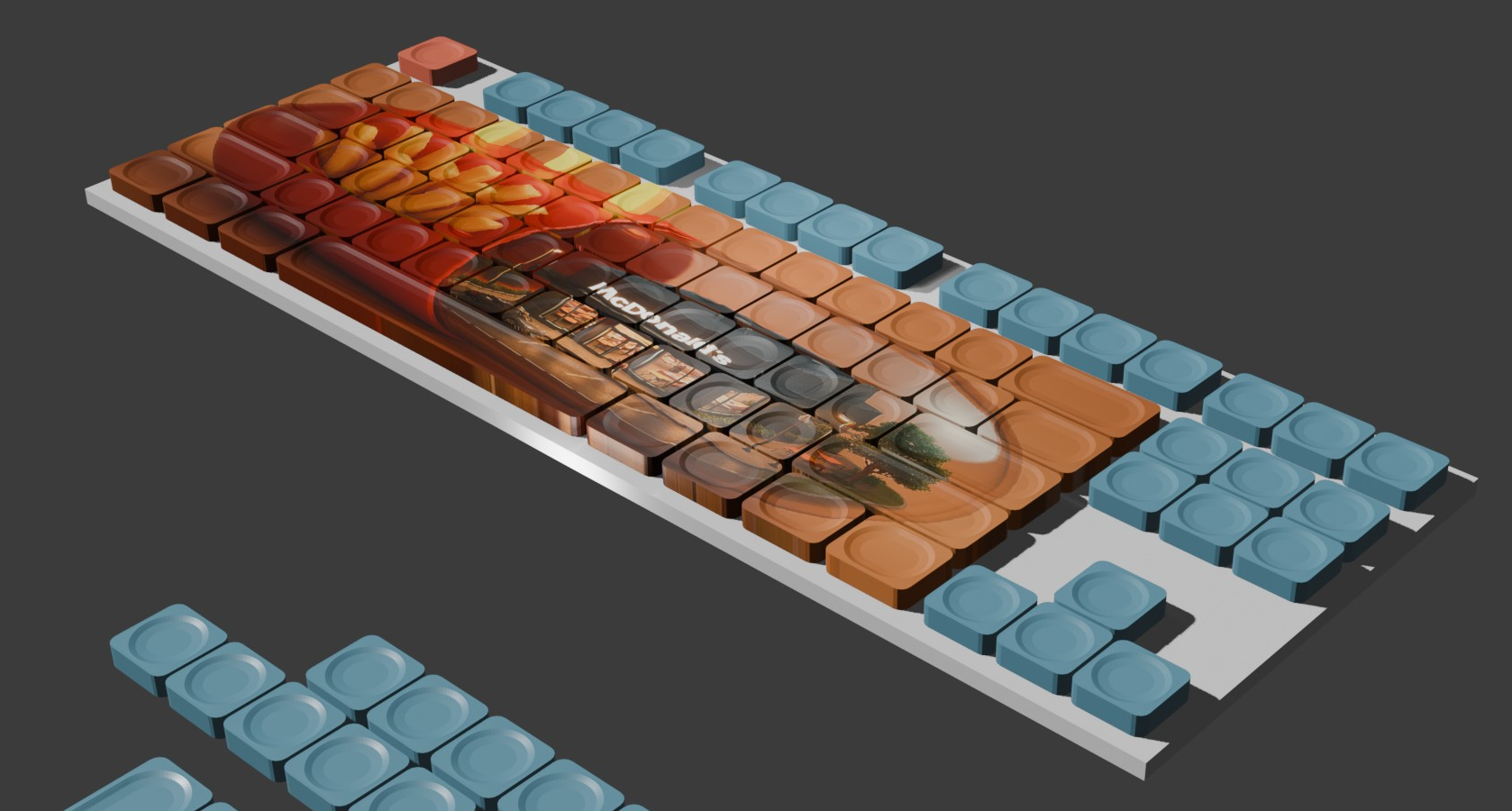

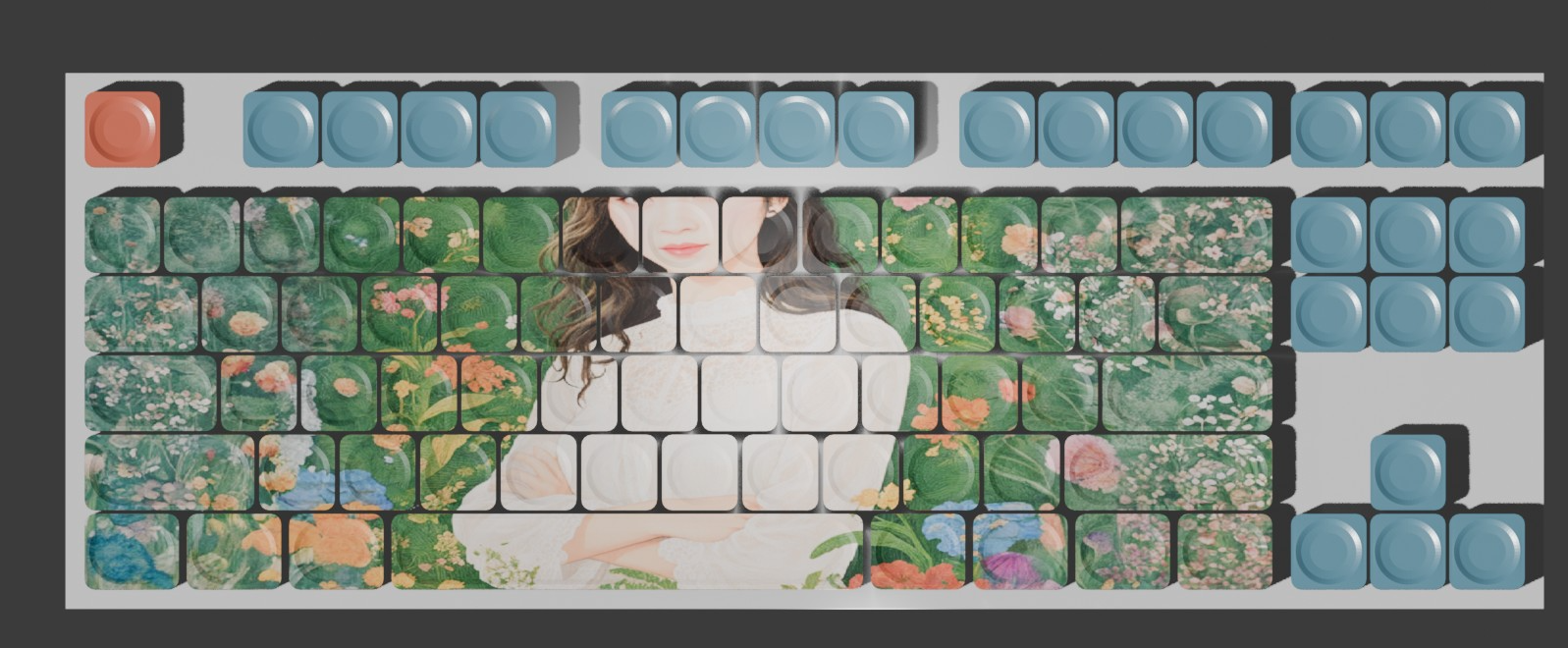

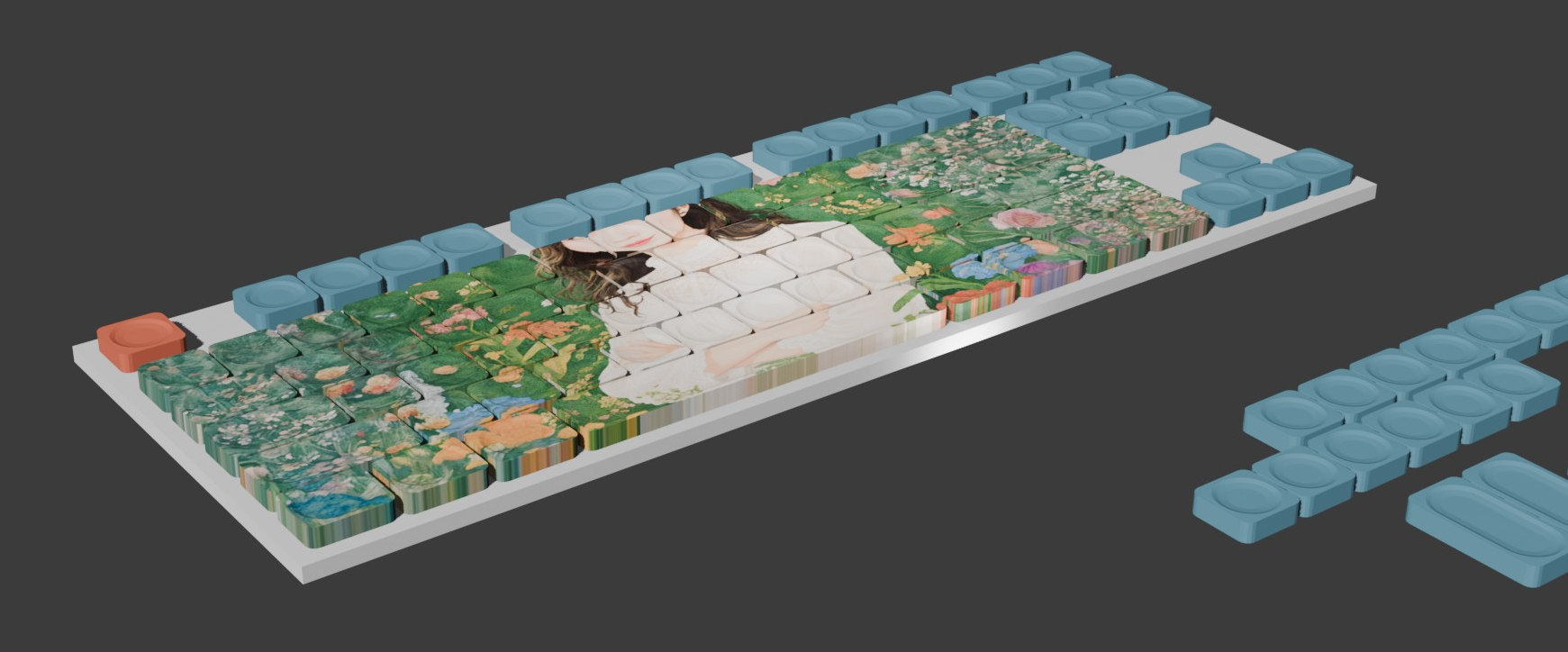

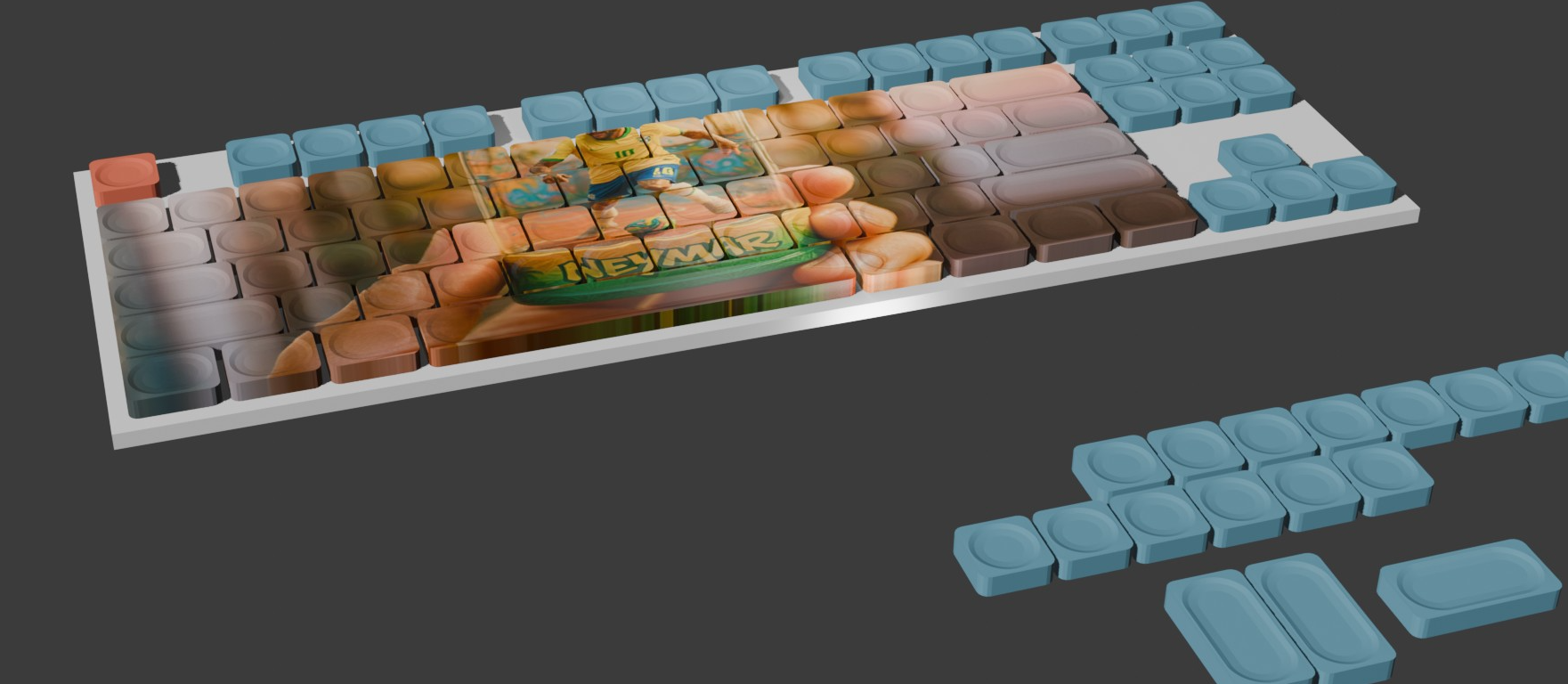

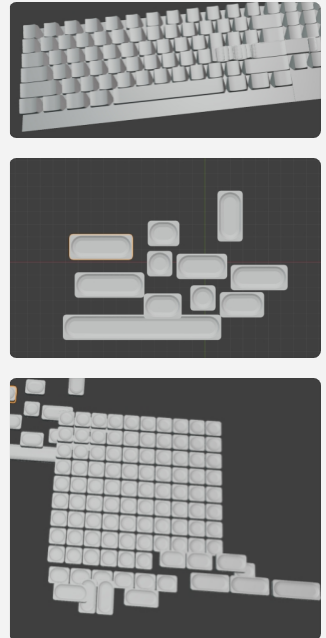

本次展现的项目制作为COMFYUI前崦+Blender后台渲染完成的3D键帽制作,应用形态为用户通过COMFYUI上传自己定义的图片,然后指定键盘模板,将图片印到键帽上,案例 展示:

二、技术实现:

由前端 COMFYUI完成用户所上传图片的加工,包含阔图和高清化,然后以接品方式调用blender 中的插件,在blender中完成键盘模型搭建和贴图和渲染。

其中blender部分的模型创建,键盘组合和灯光,渲染等过程,由我团队自己开发的插件进行实现,于用户而言无感。键盘表面颜色等渐变效果,均支持自定义。

相关3d部分在BLENDER中实现分部展示:

三、一致性和可控性问题

依我团队经验,较多项目在可控性和一致性方面落地到商业化生产,仍是比较大的挑战,所以我们通过这样的技术框架来探索更加可控的方案,接下来,我们将进一步时间让用户上传头像,挑选衣服 来实现3D场景下的走秀功能,包含运镜,希望为进一步产品落地提供基础。

四、结论

在进一步完善技术方案后,包含API等实现彻底稳定后,我们将与MYSHELL沟通,通过DOCKER结合blender+comfyui的方式,将3d服务打包装成widget封装到shellagent中,供所有myshell开发者视情况使用,详情将另与bobo进行探讨。